Esta es la segunda parte de una serie de dos partes

En la primera parte de esta serie, definimos GeoAI y resumimos el estado actual de las aplicaciones de GeoAI en la industria de la exploración minera. En esta sección se describe cómo ejecutamos un modelo de visión artificial de extremo a extremo para detectar afloramientos manchados de hierro mediante la segmentación semántica y la organización automática de mapas en datos de teledetección multiplataforma.

La presencia de óxidos de hierro es una de las pocas características diagnósticas que pueden ayudar a los esfuerzos de exploración de minerales en el espectro visual. Si bien las imágenes multiespectrales e hiperespectrales pueden revelar la presencia de muchos minerales alterados y pioneros, los datos de código abierto para un análisis espectral exhaustivo de los minerales alterados se limitan a una resolución de 30 millones de píxeles.

Si bien una resolución de 30 m es adecuada para los análisis regionales, el análisis local tiene algunas limitaciones importantes debido a la pérdida de un número desconocido de posibles afloramientos a nivel de subpíxeles. Para nuestro proyecto, tuvimos acceso a imágenes RGB con una resolución de 0,5 m, que distinguían las exposiciones más pequeñas a los afloramientos.

Hay un problema principal con el uso de la tinción con hierro como métrica para entrenar un clasificador de visión artificial. El «tinte rojo» que indica la oxidación del hierro en los afloramientos puede confundirse fácilmente con la vegetación no verde, como los líquenes y ciertos musgos esfagnos y briófitas, estos últimos predominan en pantanos y pantanos.

Inspirándonos en una publicación de Descartes Labs, decidimos probar un enfoque similar utilizando datos de radar de series temporales para detectar humedales en función de la variabilidad estacional.

Los pantanos son un tipo de humedal caracterizado por fluctuaciones variables de acidez, salinidad y nivel del agua. Nuestro objetivo era utilizar datos SAR de código abierto correspondientes a un año de nuestra área de estudio y filtrar los posibles humedales en función de la variación a lo largo del año, junto con las visualizaciones RGB y un modelo digital de elevación regional. Posteriormente, pudimos evaluar la calidad de nuestros datos de entrenamiento originales y realizar los ajustes necesarios en el modelo.

El SAR es muy sensible al agua, y un análisis de los datos del SAR de series temporales puede ayudar a distinguir esa variabilidad estacional. Al igual que los métodos de aprendizaje por conjuntos, un enfoque multiplataforma para la clasificación de la cobertura terrestre supera a las soluciones de plataforma única en teledetección.

Figura 1. Matriz de fuentes de datos del área del proyecto. Modelo digital de elevación, imagen RGB, imagen RGB con datos de entrenamiento e imagen de variación del SAR en series temporales, de izquierda a derecha.

Vamos a resumir el enfoque:

Objetivo: utilizar la visión artificial para detectar óxidos de hierro en afloramientos

Problema: El «tinte rojo» confunde el modelo entre los óxidos de hierro y la vegetación particular de los humedales

Solución: integrar imágenes de radar de series temporales para filtrar los píxeles de los humedales de la clasificación

Fuentes de datos: imágenes RGB aéreas de 0,5 m, imágenes SAR de Sentinel-1 de 10 m

1. Crear datos de entrenamiento

El conjunto de entrenamiento inicial se digitalizó manualmente a partir de la imagen RGB con etiquetas de clase para sedimentos pantanosos, afloramientos, oxidados (manchas de hierro), bosques, agua y sedimentos fluviales/lacustres (sedimentos de ríos y lagos). Posteriormente, este conjunto de datos sirvió de base para nuestro modelo de segmentación semántica y sirvió de base para evaluar las variaciones estacionales del SAR.

Ten en cuenta que, dado que empezamos con una sola imagen RGB, es posible que estos polígonos no sean del todo precisos o completos. Sin embargo, aún podemos usarlos para tener una idea de si el método funcionará o no.

2. Entrene y ejecute el modelo de visión artificial

Hay dos entradas a la CNN:

Una imagen rasterizada que contiene tres bandas, una imagen de etiqueta que contiene la etiqueta de cada píxel correspondiente a la tinción con hierro

- Una imagen rasterizada que contiene tres bandas,

- Una imagen de etiqueta que contiene la etiqueta de cada píxel correspondiente a la tinción con hierro

Usamos la arquitectura Unet para entrenar nuestro modelo de segmentación semántica.

U-net se inventó originalmente y se utilizó por primera vez para la segmentación de imágenes biomédicas. Su arquitectura puede considerarse en términos generales como una red de codificadores seguida de una red de decodificadores. A diferencia de la clasificación, en la que el resultado final de la red profunda es lo único importante, la segmentación semántica no solo requiere una discriminación a nivel de píxeles, sino también un mecanismo para proyectar en el espacio de píxeles las características discriminatorias aprendidas en las diferentes etapas del codificador.

Los cuadros azules representan mapas de características multicanal, mientras que los cuadros representan mapas de características copiados.

Con nuestras funciones de capacitación digitalizadas, entrenamos nuestro modelo y predijimos las ubicaciones de las manchas de óxido de hierro en la imagen.

Como era de esperar, hay varios falsos positivos dentro de los probables humedales.

3. Adquiera datos SAR de series temporales

Google Earth Engine es un recurso fantástico para recopilar datos de teledetección, especialmente datos de series temporales. Si no estás familiarizado con Google Earth Engine, aquí encontrarás una excelente introducción a los agregadores y reductores con ejemplos de código.

Filtramos todos los datos de Sentinel-1 de 2019 en doce imágenes, una para cada mes, agregadas por un reductor de mediana. Cada imagen contenía tres bandas:

Rojo = polarización vertical-vertical (VV)

Verde = polarización vertical-horizontal (VH)

Azul = La relación VV:VH

Las polarizaciones de banda para SAR están fuera del alcance de esta publicación y siguen siendo un tema de investigación en curso. Como breve resumen, las longitudes de onda del SAR son mucho más largas en comparación con las longitudes de onda ópticas. Por este motivo, las ondas de radar son sensibles a los diferentes hábitos texturizados de los objetos que se encuentran en el suelo, como las copas de los árboles y la rugosidad de la superficie de los afloramientos, por ejemplo. Las ondas de radar también son susceptibles a la constante dieléctrica de los materiales de la superficie, por lo que el radar es excelente para detectar la presencia de agua.

Los satélites con la capacidad de enviar radares polarizados pueden aprovechar el hecho de que, además de la dispersión (las intensidades de los píxeles SAR son una medida de la dispersión de la superficie), ciertos materiales cambiarán la polarización de la energía emitida cuando reaccionen con ella. Utilizando diferentes polarizaciones y la relación entre ambas, podemos crear un compuesto RGB, que es muy útil para las visualizaciones y añade una dimensión adicional a los datos.

Para obtener una imagen que represente la variación anual, superpusimos todas las imágenes en capas, calculamos la desviación estándar de cada píxel en las 12 imágenes y, a continuación, creamos una nueva imagen a partir de esos valores.

Al tomar una muestra de cada valor de píxel dentro de cada clase y trazarlo según la desviación estándar, podemos observar la distribución de los valores del radar a lo largo del año. Supongamos que nos centramos específicamente en la banda de polarización VV (es decir, la banda roja cuando se asigna al espacio de color RGB). En ese caso, parece haber suficiente distinción entre las clases de humedales y los afloramientos manchados de hierro.

4. Clasifique el SAR

Recientemente, Kohonen Self-Organizing Maps (SOM) ha recibido cada vez más atención por ser una red neuronal artificial infrautilizada. Los SOM son extremadamente útiles cuando no tienes datos de entrenamiento disponibles ni una indicación clara de cuántos clústeres hay en tus datos. También se diferencian de otras redes neuronales artificiales porque utilizan el aprendizaje competitivo en lugar del aprendizaje con corrección de errores.

Los SOM son esencialmente el equivalente en redes neuronales de la agrupación en clústeres de KMeans, excepto que no es necesario especificar los clústeres de números del conjunto de datos. Además, los SOM pueden entrenarse muy rápido, lo que permite observar cómo el ajuste rápido de los diferentes parámetros del modelo afecta a la red.

Esta última parte es beneficiosa ya que la red entrenada es un mapa 2D, con las coordenadas x e y correspondientes a neuronas específicas. Las neuronas de la red a veces se denominan unidades, y la neurona ganadora de cualquier píxel de la imagen es la unidad o BMU que mejor coincida con ese píxel. Las funciones sigma y de vecindad determinan el grado de influencia que las neuronas ganadoras ejercen sobre las neuronas circundantes, lo que da lugar a muchos grupos discretos o a un número menor de grupos menos definidos.

Figura 3. Dos redes SOM se entrenaron con datos SAR de series temporales con un valor sigma alto (izquierda) y un valor sigma bajo (derecha).

En cualquier caso, se requiere algún elemento de supervisión para volver a convertir la salida del SOM en clases etiquetadas. Usamos KMeans para asignar etiquetas a cada clúster de SOM y, a continuación, muestreamos la red neuronal para asignar la etiqueta de clase ganadora a cada píxel.

5. Superponga y filtre los resultados

Con nuestra imagen SAR clasificada de series temporales y los resultados de nuestro modelo de visión artificial, combinamos los resultados realizando una operación diferente. Esta operación borró todas las predicciones sobre afloramientos y óxido de hierro dentro de los límites de nuestras clases probables de humedales. Como recortamos imágenes con una resolución de 0,5 m con una resolución de 10 m, hubo cierta pérdida de resolución. Sin embargo, las clases de humedales obtenidas mediante radares hicieron un excelente trabajo a la hora de eliminar los falsos positivos.

Figura 4. La salida del modelo combinado antes y después de la operación diferencial. A) Imagen RGB B) imagen con predicciones de afloramiento obtenidas mediante un modelo de visión artificial en rojo C) afloramiento filtrado en verde superpuesta con predicciones de afloramiento originales D) afloramiento filtrado con humedales visibles.

El resultado es un conjunto de predicciones mucho más limpio. Al reducir significativamente el número de falsos positivos, nos quedan objetivos de mayor calidad para centrar los esfuerzos de exploración. Además, identificar las áreas con altas fluctuaciones del agua asociadas a los humedales puede ayudar a planificar los proyectos y a mitigar el riesgo ambiental

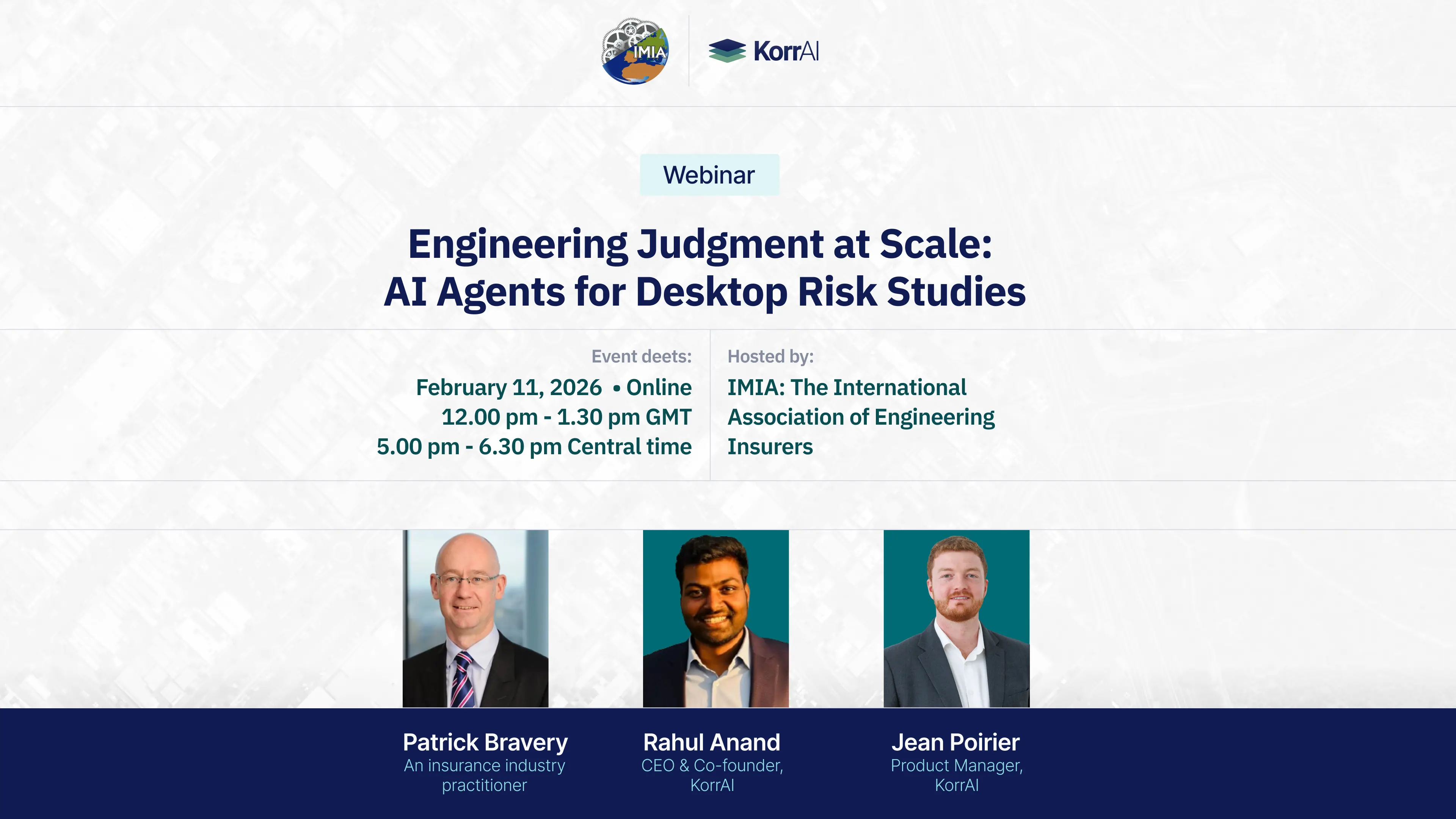

Rob dirige el desarrollo de productos en KorrAI, donde se especializa en InSAR, teledetección y análisis geoespacial impulsado por AI. Con experiencia en geología y ciencia de datos, ha trabajado en exploración, minería y análisis basados en sistemas de información geográfica. Apasionado por la tecnología y la creatividad, disfruta de la fotografía infrarroja, la música y los proyectos prácticos de carpintería y automatización.

Suscríbase a nuestro boletín

.webp)

.png)

.webp)

.svg)